W ostatniej sekcji mówiliśmy o tokenach, czyli najmniejszej wymiennej jednostce używanej przez OpenAI do ustalania cen za wywołania API. Tokeny zapewniają większą elastyczność niż mierzenie liczby słów lub zdań użytych w podpowiedziach szkoleniowych, a ze względu na szczegółowość tokenów można je łatwo przetwarzać i wykorzystywać do pomiaru cen szerokiego zakresu podpowiedzi szkoleniowych. Za każdym razem, gdy wywołujesz API z Playground lub programowo, za kulisami API oblicza liczbę tokenów użytych w monicie szkoleniowym wraz z wygenerowanym zakończeniem i pobiera opłatę za każde połączenie na podstawie całkowitej liczby wykorzystanych tokenów. OpenAI zazwyczaj pobiera stałą opłatę za 1000 tokenów, przy czym opłata zależy od silnika wykonawczego użytego w wywołaniu API. Davinci jest najpotężniejszy i najdroższy, podczas gdy Curie, Babbage i Ada są tańsze i szybsze. Tabela 2-2 przedstawia ceny różnych silników API w momencie pisania tego rozdziału (grudzień 2021 r.).

Model Cena za 1000 tokenów

Davinci (najpotężniejszy) 0,0600 USD

Curie: 0,0060 USD

Babbage’a: 0,0012 USD

Ada (najszybsza): 0,0008 USD

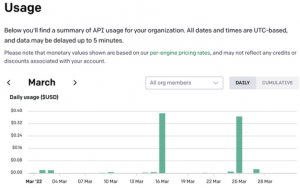

Firma pracuje nad chmurowym modelem cenowym „pay as you go”. Aby uzyskać aktualne ceny, sprawdź harmonogram cen online. Zamiast monitorować tokeny dla każdego wywołania API, OpenAI udostępnia pulpit raportowania umożliwiający monitorowanie dziennego skumulowanego użycia tokenów. Zależy od sposobu użytkowania, może wyglądać mniej więcej tak, jak na rysunku

Na rysunku możesz zobaczyć wykres słupkowy pokazujący dzienne zużycie tokenów. Pulpit nawigacyjny pomaga monitorować wykorzystanie tokenów i koszty w Twojej organizacji, dzięki czemu możesz regulować wykorzystanie API i nie przekraczać budżetu. Istnieje również możliwość monitorowania skumulowanego użycia i uzyskania zestawienia liczby tokenów na wywołanie API. Powinno to zapewnić wystarczającą elastyczność w tworzeniu zasad dotyczących zużycia tokenów i cen dla Twojej organizacji. Teraz, gdy znasz już tajniki Playground i API, przyjrzymy się wydajności GPT-3 w typowych zadaniach modelowania języka.

WSKAZÓWKA

Początkującym, którzy dopiero rozpoczęli przygodę z GPT-3, może być trudno ogarnąć kwestię zużycia tokenów. Wielu użytkowników wprowadza zbyt długie teksty podpowiedzi, co prowadzi do nadmiernego wykorzystania środków, a w konsekwencji do nieoczekiwanych opłat. Aby tego uniknąć, w pierwszych dniach korzystania z panelu wykorzystania interfejsu API obserwuj liczbę zużytych tokenów i zobacz, jak długość monitów i uzupełnień wpływa na wykorzystanie tokenów. Może pomóc zapobiec niekontrolowanemu wykorzystaniu kredytów i utrzymać wszystko w ramach budżetu.