Miliony artykułów naukowych i raportów technicznych można znaleźć w Internecie w postaci plików pdf. Takie artykuły zwykle zawierają pod koniec sekcję zatytułowaną „Odniesienia” lub „Bibliografia”, w której cytaty – ciągi znaków – są podawane w celu poinformowania czytelnika o pokrewnej pracy. Ciągi te można zlokalizować i „wydrapać” z plików pdf w celu stworzenia reprezentacji podobnej do bazy danych, która wiąże artykuły i badaczy według ich autorstwa i linków cytowań. Systemy takie jak CiteSeer i Google Scholar prezentują taką reprezentację swoim użytkownikom; za kulisami algorytmy działają, aby znaleźć artykuły, zeskrobać ciągi cytatów i zidentyfikować rzeczywiste artykuły, do których odnoszą się ciągi cytatów. Jest to trudne zadanie, ponieważ te ciągi nie zawierają identyfikatorów obiektów i zawierają błędy składni, pisowni, interpunkcji i treści. Aby to zilustrować, oto dwa stosunkowo łagodne przykłady:

1.Lashkari i in. 94] Collaborative Interface Agents, Yezdi Lashkari, Max Metral i Pattie Maes, Proceedings of the Twelfth National Conference on Articial Intelligence, MIT Press, Cambridge, MA, 1994.

- Metral M. Lashkari, Y. i P. Maes. Współpracujące agenty interfejsu. Na konferencji Amerykańskiego Stowarzyszenia na rzecz Sztucznej Inteligencji, Seattle, WA, sierpień 1994.

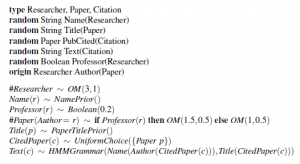

Kluczowe pytanie dotyczy tożsamości: czy są to cytaty z tego samego artykułu, czy z różnych artykułów? Zadani temu pytaniu nawet eksperci nie zgadzają się lub nie chcą podejmować decyzji, wskazując, że rozumowanie w warunkach niepewności będzie ważną częścią rozwiązania tego problemu.8 Podejścia ad hoc — takie jak metody oparte na metryce podobieństwa tekstu — często zawodzą. Na przykład w 2002 r. CiteSeer zgłosił ponad 120 różnych książek napisanych przez Russella i Norviga. Aby rozwiązać problem przy użyciu podejścia probabilistycznego, potrzebujemy modelu generatywnego dla dziedziny. To znaczy pytamy, jak te ciągi cytatów powstają na świecie. Proces zaczyna się od badaczy, którzy mają nazwiska. (Nie musimy się martwić o to, jak badacze powstali; wystarczy wyrazić naszą niepewność co do tego, ilu jest.) Ci badacze piszą artykuły, które mają tytuły; ludzie cytują prace, łącząc nazwiska autorów i tytuł pracy (z błędami) w tekst cytowania według pewnej gramatyki. Podstawowe elementy tego modelu przedstawiono na rysunku 18., obejmującym przypadek, w którym artykuły mają tylko jednego autora.

Biorąc pod uwagę tylko ciągi cytowań jako dowód, wnioskowanie probabilistyczne na podstawie tego modelu w celu wybrania najbardziej prawdopodobnego wyjaśnienia danych daje poziom błędu 2 do 3 razy niższy niż w przypadku CiteSeer (Pasula i in., 2003). Proces wnioskowania wykazuje również formę dezambiguacji zbiorowej, opartej na wiedzy: im więcej cytowań dla danego artykułu, tym dokładniej każdy z nich jest analizowany, ponieważ parsy muszą być zgodne co do faktów dotyczących artykułu.