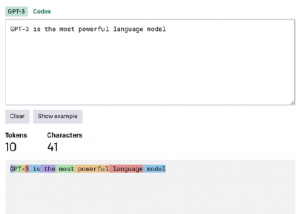

Rodzina modeli GPT przetwarza tekst za pomocą tokenów, które są typowymi sekwencjami znaków występującymi w tekście. Moduły rozumieją zależności statystyczne pomiędzy tymi tokenami i doskonale radzą sobie z tworzeniem kolejnego tokena w sekwencji tokenów. Możesz użyć poniższego narzędzia, aby dowiedzieć się, w jaki sposób fragment tekstu będzie tokenizowany przez interfejs API, oraz całkowitą liczbę tokenów w tym fragmencie tekstu

Do integracji metryki liczby tokenów w wywołaniach API do różnych punktów końcowych, możesz załatać atrybuty logprobs i echo wraz z żądaniem API, aby uzyskać pełną listę zużytych tokenów. W następnej sekcji omówimy sposób wyceny tokenów w oparciu o różne silniki wykonawcze.