Warstwa puli w sieci neuronowej podsumowuje zestaw sąsiednich jednostek z poprzedniej warstwy jedną wartością. Pooling działa jak warstwa konwolucji, z rozmiarem jądra l i krokiem s, ale zastosowana operacja jest ustalona, a nie wyuczona. Zazwyczaj żadna funkcja aktywacji nie jest powiązana z warstwą puli. Istnieją dwie popularne formy łączenia:

- Łączenie średnich oblicza średnią wartość jego l wejściowych. Jest to identyczne jak splot z jednolitym wektorem jądra k=[1/l,…,1/l]. Jeśli ustawimy l=s, efektem jest pogrubienie rozdzielczości obrazu – próbkowanie w dół – o współczynnik s. Obiekt, który zajmował, powiedzmy, 10 sekund pikseli, po zsumowaniu zajmowałby teraz tylko 10 pikseli. Ten sam uczony klasyfikator, który byłby w stanie rozpoznać obiekt o rozmiarze 10 pikseli na oryginalnym obrazie, byłby teraz w stanie rozpoznać ten obiekt na obrazie zbiorczym, nawet jeśli był zbyt duży, aby rozpoznać go na oryginalnym obrazie. Innymi słowy, łączenie średnich ułatwia rozpoznawanie na wielu skalach. Zmniejsza również liczbę wag wymaganych w kolejnych warstwach, co prowadzi do niższych kosztów obliczeniowych i prawdopodobnie szybszego uczenia się.

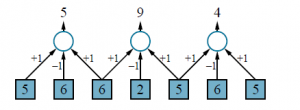

- Max-pooling oblicza maksymalną wartość swoich l wejść. Może być również używany wyłącznie do próbkowania w dół, ale ma nieco inną semantykę. Załóżmy, że zastosowaliśmy maxpooling do ukrytej warstwy [5,9,4] na rysunku :

wynikiem będzie 9, co oznacza, że gdzieś w obrazie wejściowym znajduje się ciemniejsza kropka wykrywana przez jądro. Innymi słowy, łączenie maksymalne działa jak rodzaj logicznej alternatywy, mówiąc, że dana cecha istnieje gdzieś w polu receptywnym jednostki.

Jeśli celem jest zaklasyfikowanie obrazu do jednej z c kategorii, to ostatnią warstwą sieci będzie softmax z c jednostkami wyjściowymi. Wczesne warstwy CNN mają rozmiar obrazu, więc gdzieś pomiędzy musi być znaczne zmniejszenie rozmiaru warstwy. Warstwy konwolucji i warstwy puli z krokiem większym niż 1 służą do zmniejszenia rozmiaru warstwy. Możliwe jest również zmniejszenie rozmiaru warstwy po prostu przez posiadanie w pełni połączonej warstwy z mniejszą liczbą jednostek niż poprzednia warstwa. CNN często mają jedną lub dwie takie warstwy poprzedzające ostateczną warstwę softmax.