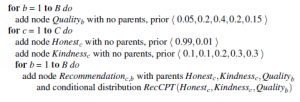

Najprostszym podejściem do wnioskowania w RPM jest po prostu skonstruowanie równoważnej sieci bayesowskiej, biorąc pod uwagę znane symbole stałe należące do każdego typu. W przypadku książek B i klientów C, podstawowy model podany wcześniej mógł być skonstruowany za pomocą prostych pętli:

Ta technika nazywa się uziemieniem lub rozwijaniem; jest to dokładny analog propozycjonalizacji dla logiki pierwszego rzędu. Oczywistą wadą jest to, że uzyskana siatka Bayesa może być bardzo duża. Co więcej, jeśli istnieje wiele obiektów kandydujących do nieznanej relacji lub funkcji — na przykład nieznany autor B2 – to niektóre zmienne w sieci mogą mieć wielu rodziców. Na szczęście często można uniknąć generowania całej niejawnej sieci Bayesa. Jak widzieliśmy w dyskusji na temat algorytmu eliminacji zmiennych na stronie 451, każda zmienna, która nie jest przodkiem zmiennej zapytania lub zmiennej dowodowej, jest nieistotna dla zapytania. Co więcej, jeśli zapytanie jest warunkowo niezależne od jakiejś zmiennej w danych dowodach, to ta zmienna jest również nieistotna. Tak więc, łącząc model, zaczynając od zapytania i dowodu, możemy zidentyfikować tylko zestaw zmiennych, które są istotne dla zapytania. Są to jedyne, które należy utworzyć, aby utworzyć potencjalnie mały fragment niejawnej sieci Bayesa. Wnioskowanie w tym fragmencie daje taką samą odpowiedź jak wnioskowanie w całej niejawnej sieci Bayesa. Inną drogą poprawy efektywności wnioskowania jest obecność powtarzającej się podstruktury w rozwiniętej sieci Bayesa. Oznacza to, że wiele czynników konstruowanych podczas eliminacji zmiennych (i podobnych rodzajów tabel tworzonych przez algorytmy grupujące) będzie identycznych; efektywne schematy buforowania przyniosły przyspieszenie o trzy rzędy wielkości w dużych sieciach. Po trzecie, algorytmy wnioskowania MCMC mają pewne interesujące właściwości w przypadku zastosowania do RPM z niepewnością relacyjną. MCMC działa poprzez próbkowanie pełnych możliwych światów, więc w każdym stanie struktura relacyjna jest całkowicie znana. W podanym wcześniej przykładzie każdy stan MCMC określiłby wartość Author(B2), a więc inni potencjalni autorzy nie są już rodzicami węzłów rekomendacji dla B2. Dla MCMC zatem niepewność relacyjna nie powoduje wzrostu złożoności sieci; zamiast tego proces MCMC obejmuje przejścia, które zmieniają strukturę relacyjną, a tym samym strukturę zależności, sieci rozwijanej. Wreszcie, w niektórych przypadkach może być możliwe całkowite uniknięcie uziemienia modelu. Dowódcy twierdzeń o rozdzielczości i systemy programowania logicznego unikają tworzenia zdań poprzez tworzenie instancji zmiennych logicznych tylko wtedy, gdy jest to konieczne do przeprowadzenia wnioskowania; to znaczy, podnoszą proces wnioskowania ponad poziom podstawowych zdań zdaniowych i sprawiają, że każdy podniesiony krok wykonuje pracę wielu podstawowych kroków. Ta sama idea może być zastosowana we wnioskowaniu probabilistycznym. Na przykład w algorytmie eliminacji zmiennej zniesiony czynnik może reprezentować cały zestaw czynników podstawowych, które przypisują prawdopodobieństwa zmiennym losowym w obrotach na minutę, gdzie te zmienne losowe różnią się tylko symbolami stałych użytymi do ich skonstruowania.