Intelektualny establishment lat pięćdziesiątych w większości wolał wierzyć, że „maszyna nigdy tego nie zrobi”. Badacze sztucznej inteligencji naturalnie zareagowali, demonstrując jeden po drugim. Skoncentrowali się w szczególności na zadaniach uważanych za wskazujące na inteligencję u ludzi, w tym na grach, łamigłówkach, matematyce i testach IQ. John McCarthy określił ten okres jako „Spójrz, mamo, bez rąk!” era. Newell i Simon kontynuowali swój sukces z LT za pomocą General Problem Solver, czyli GPS. W przeciwieństwie do LT, ten program został zaprojektowany od samego początku, aby naśladować ludzkie protokoły rozwiązywania problemów. W ograniczonej klasie łamigłówek, które potrafił, okazało się, że kolejność, w jakiej program uwzględniał cele cząstkowe i możliwe działania, była podobna do tej, w której ludzie podchodzili do tych samych problemów. Tak więc GPS był prawdopodobnie pierwszym programem, który ucieleśniał podejście „myślące po ludzku”. Sukces GPS i późniejszych programów jako modeli poznania skłonił Newella i Simona (1976) do sformułowania słynnej hipotezy dotyczącej fizycznego systemu symboli, która stwierdza, że „fizyczny system symboli ma niezbędne i wystarczające środki dla ogólnego inteligentnego działania”. Chodziło im o to, że każdy system (człowiek lub maszyna) wykazujący inteligencję musi działać poprzez manipulowanie strukturami danych złożonymi z symboli. Zobaczymy później, że hipoteza ta została zakwestionowana z wielu kierunków. W IBM Nathaniel Rochester i jego koledzy stworzyli jedne z pierwszych programów AI. Herbert Gelernter (1959) skonstruował narzędzie Geometry Theorem Prover, które było w stanie udowodnić twierdzenia, które wielu studentów matematyki uzna za dość skomplikowane. Ta praca była prekursorem współczesnych dowodów matematycznych. Ze wszystkich prac badawczych wykonanych w tym okresie, być może najbardziej wpływowa na dłuższą metę była praca Arthura Samuela nad warcabami (warcabami). Korzystając z metod, które teraz nazywamy uczeniem się przez wzmacnianie, programy Samuela nauczyły się grać na silnym poziomie amatorskim. W ten sposób obalił pogląd, że komputery mogą robić tylko to, co im każą: jego program szybko nauczył się grać w lepszą grę niż jego twórca. Program został wyemitowany w telewizji w 1956 roku, robiąc duże wrażenie. Podobnie jak Turing, Samuel miał problem ze znalezieniem czasu na komputerze. Pracując w nocy, używał maszyn, które wciąż znajdowały się na podłodze testowej w fabryce IBM. Program Samuela był prekursorem późniejszych systemów takich jak TD-GAMMON, który był jednym z najlepszych graczy w backgammona na świecie, oraz ALPHAGO (Silver i in., 2016), który zszokował świat pokonując mistrza świata w Go . W 1958 roku John McCarthy wniósł dwa ważne wkłady w rozwój sztucznej inteligencji. W MIT AI Lab Memo No. 1 zdefiniował język wysokiego poziomu Lisp, który miał stać się dominującym językiem programowania AI na następne 30 lat. W artykule zatytułowanym Programs with Common Sense przedstawił koncepcyjną propozycję systemów sztucznej inteligencji w oparciu o wiedzę i rozumowanie. Artykuł opisuje Advice Taker, hipotetyczny program, który ucieleśnia ogólną wiedzę o świecie i mógłby wykorzystać ją do tworzenia planów działania. Koncepcja została zilustrowana prostymi logicznymi aksjomatami, które wystarczą do wygenerowania planu dojazdu na lotnisko. Program został również zaprojektowany tak, aby akceptować nowe aksjomaty w normalnym toku działania, umożliwiając w ten sposób osiąganie kompetencji w nowych obszarach bez konieczności przeprogramowywania. Doradca uosabiał w ten sposób główne zasady reprezentacji wiedzy i rozumowania: że warto mieć formalną, wyraźną reprezentację świata i jego działania oraz móc manipulować tą reprezentacją za pomocą procesów dedukcyjnych. Artykuł wpłynął na przebieg sztucznej inteligencji i pozostaje aktualny do dziś. W 1958 roku Marvin Minsky przeniósł się do MIT. Jego początkowa współpraca z McCarthym nie trwała jednak długo. McCarthy kładł nacisk na reprezentację i rozumowanie w logice formalnej, podczas gdy Minsky był bardziej zainteresowany uruchamianiem programów i ostatecznie opracował antylogiczne podejście. W 1963 roku McCarthy założył laboratorium AI w Stanford. Jego plan wykorzystania logiki do zbudowania ostatecznego Doradcy zostało osiągnięte dzięki odkryciu przez J. A. Robinsona w 1965 roku metody rozwiązania (algorytm pełnego dowodzenia twierdzeń dla logiki pierwszego rzędu). Praca w Stanford kładła nacisk na ogólne metody logicznego rozumowania. Zastosowania logiki obejmowały systemy odpowiadania na pytania i planowania Cordella Greena oraz projekt robotyki Shakey w Stanford Research Institute (SRI). Ten ostatni projekt, był pierwszym, który zademonstrował pełną integrację logicznego rozumowania i aktywności fizycznej. Na MIT Minsky nadzorował grupę studentów, którzy wybrali ograniczone problemy, które, jak się wydawało, wymagały inteligencji do rozwiązania. Te ograniczone domeny stały się znane jako mikroświaty. Program SAINT Jamesa Slagle’a (1963) był w stanie rozwiązać problemy integracji rachunku różniczkowego w formie zamkniętej, typowe dla studiów pierwszego roku. Program ANALOGIA Toma Evansa (1968) rozwiązał problemy analogii geometrycznych, które pojawiają się w testach IQ. Program STUDENT Daniela Bobrowa (1967) rozwiązał problemy z historią algebry, takie jak:

Jeśli liczba klientów, których pozyskuje Tom, jest dwukrotnością kwadratu 20% liczby reklam, które wyświetla, a liczba reklam, które wyświetla, wynosi 45, to jaką liczbę klientów pozyskuje Tomek?

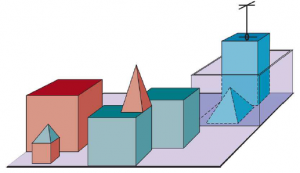

Najbardziej znanym mikroświatem jest świat klocków, który składa się z zestawu solidnych bloków umieszczonych na blacie (lub częściej symulacji blatu), jak pokazano na rysunku

Typowym zadaniem na tym świecie jest przestawianie klocków w określony sposób za pomocą ręki robota, która może podnosić jeden blok na raz. Świat bloków był domem dla projektu wizji Davida Huffmana (1971), wizji i propagowania ograniczeń pracy Davida Waltza (1975), teorii uczenia się Patricka Winstona (1970), programu rozumienia języka naturalnego Terry’ego Winograda (1972) i planista Scotta Fahlmana (1974). Wczesne prace oparte na sieciach neuronowych firm McCulloch i Pitts również rozkwitły. Praca Shmuela Winograda i Jacka Cowana (1963) pokazała, jak duża liczba elementów może wspólnie reprezentować indywidualną koncepcję, z odpowiednim wzrostem odporności i równoległości. Metody uczenia się Hebba zostały wzmocnione przez Berniego Widrowa (Widrow i Hoff, 1960; Widrow, 1962), który nazwał swoje sieci adalines, oraz przez Franka Rosenblatta (1962) za pomocą swoich perceptronów. Twierdzenie o zbieżności perceptronu (Block et al., 1962) mówi, że algorytm uczenia się może dostosować siłę połączenia perceptronu aby dopasować dowolne dane wejściowe, o ile takie dopasowanie istnieje.