Data Mining

analiza: Przemyślane badanie systemów w świecie rzeczywistym.

analityka: analiza obejmująca matematykę. (Ten termin jest używany bardzo różnie przez różne osoby i może odnosić się do wszystkiego, od prostych podsumowań danych historycznych po bardzo złożone modele predykcyjne. Zawsze zadawaj pytania!)

asocjacji reguły: narzędzia do identyfikacji kombinacji często spotykanych elementów. Najczęstszym zastosowaniem reguł asocjacji jest analiza koszyka rynkowego.

assumption (założenie): coś, co rzekomo jest prawdą. Założenia są podstawą wszystkich analiz statystycznych. (Ważne jest, aby analityk wybrał metody oparte tylko na założeniach, które są uzasadnione dla aplikacji).

average (średnia): każda miara opisująca środek (bardziej formalnie „tendencję centralną” lub „lokalizację”) rozkładu. W analityce termin „średnia” zwykle odnosi się do średniej, ale może odnosić się do mediany lub trybu.

bayesowska sieć: rodzaj sieci neuronowej. Sieć bayesowska opiera się na podstawach teorii prawdopodobieństwa. (Zobacz także sieć neuronowa.)

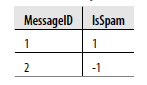

binarny: posiadający dokładnie dwa alternatywne stany.

binowanie: Organizowanie danych w grupy. Można to zrobić w celu ułatwienia analizy lub w celu ochrony prywatności.

causation (związek przyczynowy): akt wywoływania efektu lub spowodowania czegoś. Wyrażenie „korelacja nie oznacza związku przyczynowego” oznacza, że fakt, że obserwowane są dwie rzeczy, które zachodzą razem, nie wystarczy, aby udowodnić, że jedna z nich była przyczyną drugiej.

Chi-kwadrat: Statystyka testowa, prawdopodobnie najbardziej rozpowszechniona ze wszystkich metod testowania hipotez statystycznych. Zwykle stosowany w połączeniu z tabelami tabel krzyżowych.

Chi-squared Automatic Interaction Detector (Automatyczny detektor interakcji chi-kwadrat) (CHAID): rodzaj drzewa decyzyjnego. CHAID opiera się na statystyce chi-kwadrat i testach niezależności między zmiennymi kategorialnymi.

classification (klasyfikacja): techniki organizowania danych w grupy związane z konkretnym wynikiem, takie jak prawdopodobieństwo zakupu produktu lub zdobycia dyplomu ukończenia szkoły wyższej.

Classification and Regression Tree (Drzewo klasyfikacji i regresji) (C&RT): rodzaj drzewa decyzyjnego. C&RT opiera się na metodach regresji liniowej.

cluster analysis (clustering) (analiza skupień (klastrowanie)): techniki organizowania danych w grupy podobnych przypadków.

coding (kodowanie): w analizie tekstu kategoryzacja tekstu na podstawie jego znaczenia. Te kategoryzacje mogą być używane w taki sam sposób, jak każda inna zmienna kategorialna. Historycznie wykonywane ręcznie, automatyczne procesy kodowania stają się teraz dostępne.

correlation (korelacja): asocjacja wartości dwóch lub więcej zmiennych.

Cross-Industry Standard Process for Data Mining (CRISP-DM) (Międzybranżowy Standardowy Proces Eksploracji Danych): Dokładnie to, co mówi, lub jak to ujęli ludzie z projektu CRISP-DM, „neutralny dla branży i narzędzi model przetwarzania danych”.

crosstabulation (tabele krzyżowe): Podsumowanie interakcji zmiennych kategorialnych w tabeli.

dashboard (pulpit): predefiniowany raport do przeglądania online, zwykle składający się z prostych tabel i wykresów, z pewnymi opcjami interakcji użytkownika. Pulpity nawigacyjne są zwykle zaprojektowane do użytku przez menedżerów biznesowych w celu wspierania procesów decyzyjnych.

data mining (eksploracja danych): Ogólny termin na techniki analityczne, które ułatwiają szybkie wykrywanie wzorców i budowanie modeli, szczególnie przy dużych zestawach danych.

dataset (zbiór danych): zbiór powiązanych pomiarów. W kontekście eksploracji danych zwykle odnosi się to do zorganizowanego pliku elektronicznego lub bazy danych zawierającej zapisy rutynowej działalności biznesowej lub inne informacje istotne dla konkretnego projektu eksploracji danych.

dependent variable (zmienna zależna): w modelu zmienna, której wartość zależy bezpośrednio od wartości innych (niezależnych) zmiennych. Zmienna zależna jest zwykle elementem, który górnicy danych próbują przewidzieć lub kontrolować.

drzewo decyzyjne: rodzina metod klasyfikacji, których wyniki są zwykle przedstawiane na wykresie drzewiastym.

forecasting (prognozowanie): przewidywanie przyszłych wartości niektórych zmiennych. Metody prognozowania są często stosowane do przewidywania sprzedaży, cen lub innych miar ekonomicznych.

frequency (częstotliwość): liczba wystąpień określonej wartości w zbiorze danych.

holdout data (dane wstrzymania): dane, które nie zostały wykorzystane w procesie dopasowania modelu (ani do szkolenia, ani do testowania). Służy do oceny wydajności modelu po zakończeniu procesu dopasowania.

hipoteza: domniemanie lub przekonanie. Wnioskowanie statystyczne opiera się na tworzeniu i testowaniu hipotez. W statystyce wnioskowania hipoteza jest twierdzeniem o związku między dwoma mierzonymi zjawiskami.

hipotez testowanie: sedno statystyki wnioskowania polegającej na ocenie dwóch hipotez, znanych jako hipoteza „zerowa” i „alternatywna”. Hipoteza „alternatywna” stwierdza, że dwa mierzone zjawiska są w jakiś sposób powiązane, a hipoteza „zerowa” jest po prostu domyślnym przekonaniem, że taki związek nie istnieje. Testowanie hipotez analizuje przykładowe dane w celu ustalenia, który z nich najlepiej obsługuje dane.

independent variable (zmienna niezależna): w modelu zmienne, które mogą wpływać na zmienną zależną. Mogą one, ale nie muszą być kontrolowane. Model prognozowania sprzedaży może mieć między innymi zmienną zależną całkowitej rocznej sprzedaży (w dolarach) i zmienne niezależne, takie jak stopa inflacji, wydatki na reklamę i liczba wykonanych połączeń.

input (dane wejściowe): zmienna niezależna

Kohonena Sieć: rodzaj sieci neuronowej. W przeciwieństwie do innych typów sieci neuronowych wymienionych w tej książce, sieci Kohonen są używane w aplikacjach klastrowych (zwanych również uczeniem bez nadzoru).

liniowa regresja: w statystyce metoda modelowania związku między zmiennymi zależnymi i niezależnymi. Regresja liniowa tworzy model, dopasowując linię prostą do wartości w zestawie danych.

logistyczna regresja: Podobnie jak regresja liniowa, statystyczna metoda modelowania zależności między zmiennymi zależnymi i niezależnymi na podstawie prawdopodobieństwa. Jednak w binarnej regresji logistycznej zmienna zależna (efekt lub wynik) może mieć tylko jedną z dwóch wartości, jak np. Płeć dziecka lub wyniki wyborów. (Wielomianowa regresja logistyczna pozwala na więcej niż dwie możliwe wartości.) Model regresji logistycznej jest tworzony przez dopasowanie danych do funkcji logit. (Zmienna zależna to 0 lub 1, a krzywa regresji ma kształt podobny do litery „s”).

market basket analysis (analiza koszyka rynkowego): Identyfikacja kombinacji produktów często kupowanych w ramach jednej transakcji.

market research (badanie rynku): Zbieranie informacji o klientach i potencjalnych klientach.

model: Równanie lub zestaw równań, używane do opisania zachowania systemu.

multilayer perceptron (MLP) (wielowarstwowy perceptron): rodzaj sieci neuronowej. MLP jest najczęstszą i prawdopodobnie najprostszą siecią neuronową używaną do klasyfikacji.

multivariate (wielowymiarowy): w literaturze statystycznej model z więcej niż jedną zmienną zależną. Również termin używany do opisania niektórych testów, w których więcej niż jedna zmienna niezależna jest zmieniana w tym samym czasie.

neuronowa sieć: rodzina typów modeli zdolnych do symulacji niektórych bardzo złożonych systemów.

node (węzeł): w niektórych aplikacjach do eksploracji danych funkcja (taka jak budowanie konkretnego modelu drzewa decyzyjnego, tworzenie wykresu rozrzutu lub usuwanie niekompletnych spraw z zestawu danych, wśród wielu innych możliwości) reprezentowana przez mały obraz lub ikonę, a nie według pozycji menu lub kodu. W sieciach neuronowych element struktury sieci

operacyjne badania (OR): Termin ogólny dla optymalizacji i innych metod matematycznych stosowane do wspomagania podejmowania decyzji.

odstająca wartość: wartość danych tak nietypowa, że uwzględnienie jej w analizie może prowadzić do bezużytecznych lub wprowadzających w błąd wyników. Analitycy czasami decydują się na wykluczenie tych wartości lub dokładne zbadanie ich wpływu na wydajność modelu.

output (wyjście): zmienna zależna.

overfitting (nadmierne dopasowanie): występuje, gdy model dokładnie opisuje dane wykorzystane do szkolenia, ale powoduje błędy lub sprawia, że prognozy są słabe w przypadku zastosowania do innych próbek danych.

parametr: wartość opisująca pewien aspekt rozkładu wartości w populacji. Prawdziwe wartości parametrów są generalnie nieznane, stąd potrzeba statystyki.

populacja: wszystkie elementy typu, którego chcesz się uczyć. Na przykład, jeśli studiujesz ludzi, populacją mogą być wszyscy ludzie, którzy żyją lub mogą się urodzić. Jeśli studiujesz płatności za rachunki, populacja może być wszystkimi możliwymi płatnościami za rachunki.

prognoza: Oczekiwanie na przyszłe zdarzenie.

predykcyjna analiza: metody analityczne stosowane do prognozowania. Praktyka stosowania modelowania matematycznego do przewidywania wyników.

predyktor: zmienna niezależna.

profilowanie: w statystykach termin ma takie samo znaczenie jak „klasyfikacja”.

quick, unbiased, and efficient statistical tree (QUEST) (szybkie, obiektywne i wydajne drzewo statystyczne): QUEST jest rodzajem drzewa decyzyjnego, zaprojektowanym z myślą o szybkim wykonywaniu i stanowi ważną kwestię dla niektórych eksploratorów danych pracujących z dużymi zestawami danych.

Radial Base Function (RBF): rodzaj sieci neuronowej. Podstawowa funkcja radialna jest odmianą perceptronu wielowarstwowego, zaprojektowanego tak, aby uzyskiwać wyniki szybciej niż konwencjonalny perceptron wielowarstwowy.

random sample (próba losowa): podzbiór populacji, dla którego każdy członek populacji ma równe szanse na wybór.

regresja: rodzina metod dopasowania linii lub krzywej do zestawu danych, stosowana w celu uproszczenia lub określenia liczby pozornie przypadkowych punktów danych.

raport: zbiór podsumowań danych, zwykle porównań sum, średnich i wartości procentowych.

response (odpowiedź): zmienna zależna.

ruleset (zestaw reguł): zbiór „if. . . następnie ”, które mogą być wykorzystane do prognozowania.

sample (próbka): podzbiór populacji. Próbka może zawierać całość lub tylko część dostępnych danych.

segmentacja: w marketingu akt definiowania dowolnej grupy klientów, niekoniecznie poprzez zastosowanie jakichkolwiek metod analitycznych. W eksploracji danych i statystyce segmentacja jest taka sama jak klastrowanie. Jednak analitycy i inni często używają tego terminu od niechcenia w odniesieniu do klasyfikacji.

sentymentów analiza: Metody analizy tekstu stosowane w celu uzyskania informacji o opiniach lub postawach mówcy lub pisarza (lub populacji mówców lub pisarzy).

significant (znaczący): efekt, który można wyraźnie oddzielić za pomocą metod analizy statystycznej od naturalnej zmienności (szumu) w danych. (Pamiętaj, że coś może być „znaczące” w tym sensie i nadal być zupełnie nieistotne z praktycznego punktu widzenia.) Eksperci danych nie używają tego terminu, jeśli w ogóle. Statystycy używają go cały czas.

statystyka: nauka wnioskowania na temat populacji na podstawie analizy matematycznej przykładowych danych.

strukturalnych równań modelowanie: ogólny termin określający różne metody stosowane w celu ustalenia, czy model reprezentujący rzeczywisty system jest rzeczywiście zgodny z danymi.

strukturalne dane: w statystyce i eksploracji danych każdy rodzaj danych, których wartości mają jasno określone znaczenie, takie jak liczby i kategorie.

survey research (badanie ankietowe): zadawanie ludziom pytań i wykorzystywanie odpowiedzi jako danych.

testowanie zestawu danych: próbka danych wykorzystywanych przy każdej iteracji procesu szkoleniowego w celu ponownego zamontowania modelu (ale możesz także usłyszeć ten termin używany do opisania danych wstrzymania). Termin ten jest najczęściej używany w kontekście dopasowania modelu sieci neuronowej do danych; oprogramowanie dopasowuje formę modelu do podzbioru danych (zwanego zestawem danych szkoleniowych, a następnie ocenia dopasowanie modelu do innego podzbioru, zwanego zestawem danych testowych. Proces ten można powtórzyć tysiące razy, a ostateczny model sieci neuronowej zostanie być tym, który najlepiej pasuje do zestawu danych testowych.

tekstu analiza: metody analityczne zastosowane do tekstu.

tekstu eksploracja: techniki eksploracji danych stosowane w tekście. Ponieważ opierają się one na tych samych podstawowych metodach analizy, co analiza tekstu, eksploracja tekstu jest synonimem analizy tekstu, a użycie terminu eksploracja jest przede wszystkim kwestią stylu i kontekstu.

training (szkolenie): W eksploracji danych proces dopasowywania modelu do danych. Jest to proces iteracyjny i może obejmować tysiące lub więcej iteracji.

training dataset (zestaw danych szkoleniowych): w eksploracji danych: próbka danych wykorzystywanych przy każdej iteracji procesu szkoleniowego do oceny dopasowania modelu.

unstructured data (nieustrukturyzowane dane): tekst, audio, wideo i inne typy złożonych danych, które nie mieszczą się łatwo w konwencjonalnej relacyjnej bazie danych. Dane nieustrukturyzowane nie są tak proste jak liczby i krótkie ciągi, których używa większość analityków danych.

walidacja: czynność testowania modelu z danymi, które nie zostały użyte w procesie dopasowania modelu.

wizualne programowanie: Definiowanie przepływu pracy poprzez manipulowanie obrazami graficznymi zamiast pisania kodu lub używania menu i okien dialogowych. Często używany do eksploracji danych.

wizualizacja: badanie danych za pomocą wykresów. Termin ten jest najczęściej używany, gdy wykresy są nowego lub nowego typu.